Papers clave que están definiendo la IA en 2026

Gran parte de los trabajos que están marcando el desarrollo real de la inteligencia artificial en 2026 no se publicaron este mismo año. En investigación, el impacto tarda en consolidarse: las citas maduran después, la adopción técnica llega con retraso y muchas veces el valor de un paper solo se entiende cuando empieza a influir en producto, tooling o arquitectura.

Por eso este análisis combina papers fundacionales que siguen definiendo el stack actual con trabajos recientes de 2024 y 2025 que están empujando la agenda técnica. El objetivo no es listar papers famosos, sino identificar qué investigaciones tienen aplicación práctica real y cuáles conviene vigilar aunque no estén maduras para adopción general.

Contexto editorial y metodología de selección

Este artículo parte de una premisa simple: impacto no es lo mismo que novedad. Un paper puede haberse publicado hace años y seguir condicionando el diseño de sistemas de IA actuales. Del mismo modo, un trabajo reciente puede no tener muchas citas, pero sí una señal fuerte de comunidad científica, premios, repositorios activos o adopción rápida por equipos técnicos.

La selección prioriza cuatro criterios: visibilidad científica, relevancia técnica, disponibilidad práctica y aplicación real en sistemas de IA. Eso incluye presencia en NeurIPS, ICML, ICLR y CVPR, crecimiento de citas, discusión técnica, código público cuando existe y potencial de integración en LLM, agentes, retrieval, visión o generación.

Visibilidad

Señal científica y de comunidad. Papers con citas consolidadas o reconocimiento reciente fuerte en conferencias, premios y repositorios técnicos.

Relevancia

Valor técnico real. Se priorizan mejoras en arquitectura, razonamiento, multimodalidad, retrieval, seguridad y eficiencia.

Práctica

Posibilidad de adopción. Se valora código abierto, reproducibilidad, adopción en frameworks o facilidad de prueba en entornos reales.

Impacto

Utilidad en IA actual. Se mide si afecta de forma clara a LLM, agentes, búsqueda, generación, visión o infraestructura de entrenamiento.

Esta selección combina papers fundacionales todavía vigentes, trabajos con adopción práctica consolidada y papers recientes con fuerte señal de comunidad científica. No pretende ser un ranking absoluto, sino una guía para identificar qué investigaciones están teniendo impacto real en sistemas de IA en 2026.

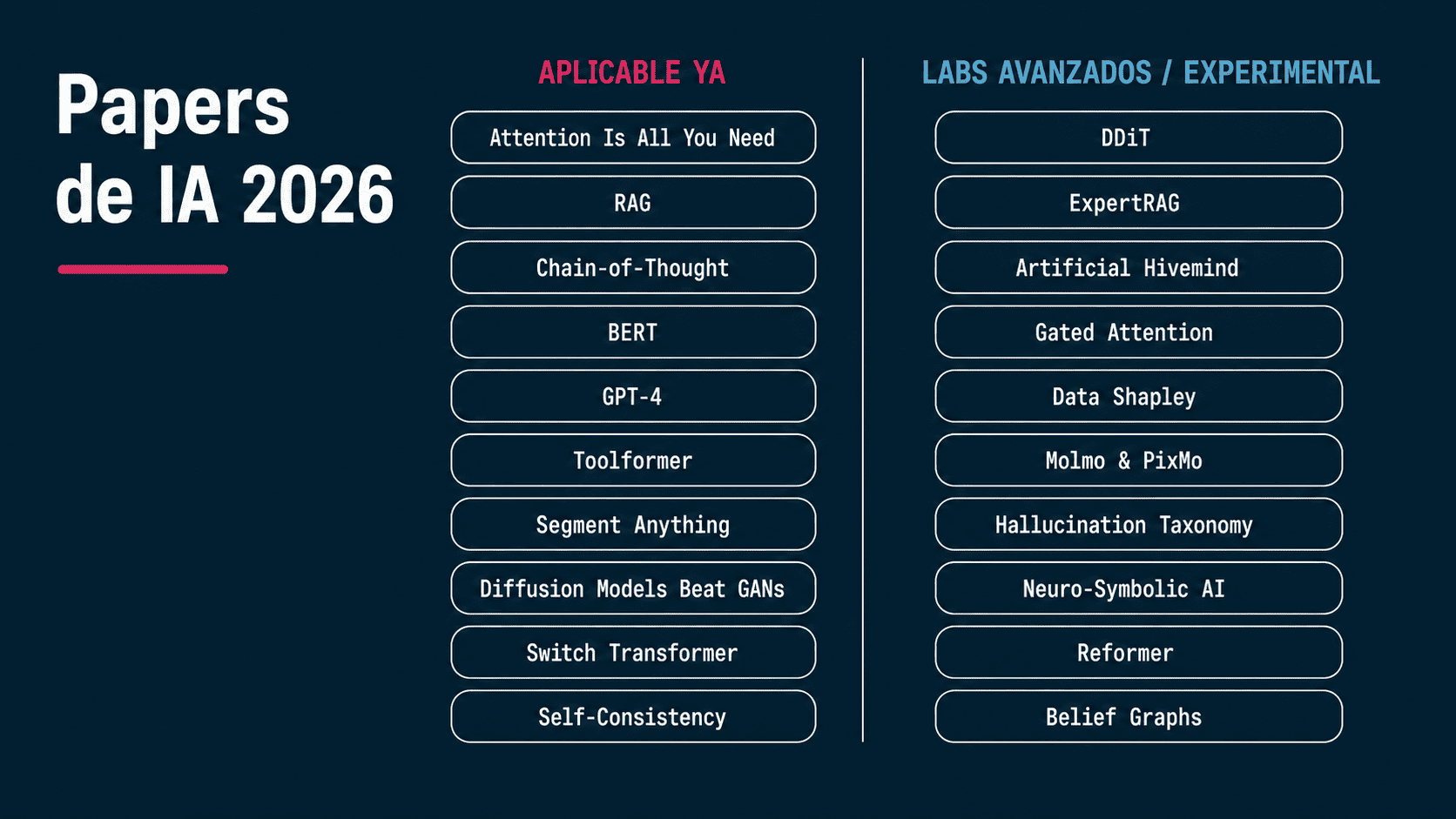

Nivel de adopción de los papers

No todos los trabajos tienen el mismo nivel de madurez. Para facilitar la lectura, la selección se divide en tres niveles: papers aplicables ya, útiles para labs avanzados y experimentales que apuntan una línea futura pero aún no están listos para adopción general.

| Nivel | Qué significa |

|---|---|

| Aplicable ya | Puede probarse o integrarse en sistemas actuales con retorno técnico o funcional visible. |

| Útil para labs avanzados | Requiere infraestructura, investigación adicional o tocar arquitectura en profundidad. |

| Experimental | Señala una línea prometedora, pero todavía no está madura para adopción general. |

Los 25 papers con mayor impacto actual

La tabla mezcla dos bloques: papers fundacionales que siguen definiendo la IA en 2026 y trabajos recientes que están empujando la agenda técnica actual. Esa mezcla es deliberada, porque en IA el impacto real no siempre coincide con el año de publicación.

| Paper | Año | Área | Nivel de adopción | Aplicación |

|---|---|---|---|---|

| Attention Is All You Need | 2017 | Transformers | Aplicable ya | arquitectura base de LLM |

| BERT: Pre-training of Deep Bidirectional Transformers | 2018 | NLP | Aplicable ya | comprensión de búsqueda |

| Language Models are Few-Shot Learners | 2020 | LLM | Aplicable ya | prompting |

| Retrieval-Augmented Generation | 2020 | retrieval | Aplicable ya | grounding factual |

| Chain-of-Thought Prompting | 2022 | reasoning | Aplicable ya | reasoning en LLM |

| ReAct | 2022 | agentes | Aplicable ya | agentes con acciones |

| Toolformer | 2023 | agentes | Aplicable ya | uso de herramientas |

| Self-Consistency Improves CoT | 2022 | reasoning | Aplicable ya | mejora de precisión |

| Switch Transformer | 2021 | escalado | Aplicable ya | mixture-of-experts |

| PaLM | 2022 | LLM | Aplicable ya | modelos a gran escala |

| CLIP | 2021 | multimodal | Aplicable ya | texto-imagen |

| DALL-E | 2021 | generative AI | Aplicable ya | generación visual |

| Diffusion Models Beat GANs | 2021 | generative AI | Aplicable ya | imagen generativa |

| Flamingo | 2022 | multimodal | Aplicable ya | LLM multimodales |

| GPT-4 Technical Report | 2023 | LLM | Aplicable ya | frontier models |

| LLaMA | 2023 | open models | Aplicable ya | ecosistema open-source |

| Segment Anything | 2023 | visión | Aplicable ya | segmentación universal |

| Mixture-of-Experts Transformers | 2022 | escalado | Aplicable ya | eficiencia LLM |

| Reformer | 2020 | eficiencia | Útil para labs avanzados | transformers largos |

| Learning Dynamic Belief Graphs | 2025 | reasoning | Experimental | multi-agent reasoning |

| DDiT: Dynamic Patch Scheduling | 2025 | diffusion | Útil para labs avanzados | optimización generación |

| ExpertRAG | 2025 | retrieval | Útil para labs avanzados | RAG avanzado |

| Neuro-Symbolic AI Review | 2025 | reasoning | Experimental | reasoning híbrido |

| Hallucination Taxonomy in LLM Citations | 2026 | seguridad | Experimental | detección de alucinaciones |

| Artificial Hivemind Systems | 2025 | agentes | Experimental | coordinación multi-agente |

Principales líneas de investigación detectadas

Modelos de lenguaje cada vez más grandes

PaLM, GPT-4 y los enfoques mixture-of-experts muestran que el escalado sigue siendo una estrategia dominante. Sus aplicaciones más claras están en asistentes conversacionales, copilotos de programación y sistemas de análisis de texto.

Razonamiento en modelos de lenguaje

Chain-of-Thought, Self-Consistency y ReAct empujan una misma idea: no basta con que el modelo responda, importa cómo estructura el proceso de resolución. Esto afecta directamente a QA complejo, generación de código y reasoning científico o técnico.

IA multimodal

CLIP, Flamingo, DALL-E y la nueva oleada de VLM abiertos muestran que la combinación de modalidades ya no es un extra, sino una capa central del ecosistema actual. Las aplicaciones más claras están en búsqueda visual, generación de imágenes y asistentes multimodales.

Sistemas de recuperación de información

RAG y sus variantes combinan generación con recuperación documental. Son la base de buscadores conversacionales, copilotos empresariales y asistentes documentales con grounding factual.

Sistemas multi-agente

Las investigaciones más recientes exploran cómo múltiples agentes pueden colaborar, coordinarse o razonar juntos. Sus aplicaciones potenciales están en simulaciones complejas, automatización empresarial y coordinación de sistemas autónomos.

Casos de uso prácticos en industria

Copilots y asistentes empresariales

RAG, ReAct y Toolformer son la base técnica de muchos asistentes internos, copilots y sistemas con acceso a herramientas.

Reasoning y multimodalidad

Los trabajos sobre CoT, multimodalidad abierta, evaluación y coordinación multi-agente están marcando laboratorios y equipos avanzados.

Escalado, entrenamiento e inferencia

Switch Transformer, DDiT, Gated Attention y Data Shapley interesan por eficiencia, control del coste y calidad del entrenamiento.

Search y sistemas con grounding

BERT y RAG siguen siendo esenciales para comprensión, recuperación y diseño de respuestas trazables en entornos de búsqueda.

Qué debería vigilar una empresa

Equipos de producto IA

Deberían seguir especialmente grounding factual, reducción de alucinaciones, eficiencia de inferencia y agentes capaces de usar herramientas. Son las líneas que más rápido se convierten en funcionalidades, ahorro de coste o mejora de experiencia.

Equipos de investigación

Las líneas más relevantes son modelos multimodales, arquitecturas híbridas, reasoning estructurado y multi-agent AI. Aquí está la señal más fuerte de cambio técnico para los próximos ciclos.

Empresas que solo consumen modelos o APIs

Las tendencias con mayor impacto para negocio están en agentes capaces de ejecutar tareas, mejoras en precisión factual, reducción de costes de inferencia e integración multimodal. No hace falta entrenar modelos propios para beneficiarse de estas líneas.

Tabla de aprendizajes prácticos derivados de los papers

| Tip | Cómo aplicarlo | Paper origen |

|---|---|---|

| Diseñar contenido recuperable | usar estructura clara para retrieval | Retrieval-Augmented Generation |

| Crear bloques citables | párrafos definitorios | Retrieval-Augmented Generation |

| Explicar razonamiento paso a paso | prompts estructurados | Chain-of-Thought |

| Generar múltiples razonamientos | seleccionar el mejor resultado | Self-Consistency |

| Permitir que la IA use herramientas | integrar APIs | Toolformer |

| Combinar reasoning y acciones | agentes con decisiones | ReAct |

| Escalar modelos eficientemente | mixture-of-experts | Switch Transformer |

| Usar embeddings multimodales | texto + imagen | CLIP |

| Entrenar con datasets masivos | escalado | PaLM |

| Optimizar generación visual | diffusion transformers | DDiT |

| Combinar retrieval y expertos | factual AI | ExpertRAG |

| Representar conocimiento en grafos | reasoning estructurado | Belief Graphs |

| Detectar alucinaciones | verificación de outputs | Hallucination Taxonomy |

| Coordinar múltiples agentes | sistemas cooperativos | Artificial Hivemind |

Anexos útiles para reforzar autoridad editorial

Estos recursos permiten contrastar la selección con criterios externos y justificar por qué ciertos papers aparecen aunque no tengan todavía masa crítica de citas.

- Nature Index y criterios de impacto reciente. Útil para separar impacto por citas de impacto por novedad y justificar por qué no todo paper reciente debe tratarse igual.

- NeurIPS 2025 Best Paper Awards. Sirve para justificar papers con señal fuerte de comunidad, aunque todavía no tengan masa crítica de citas.

- ICLR 2025 Outstanding Paper Awards. Ayuda a explicar criterio de selección cualitativa y rigor técnico en trabajos recientes.

- CVPR 2025 Best Papers and Honorable Mentions. Clave para justificar selección en visión, 3D, VLM y pipelines visuales con señal fuerte para 2026.

Las interpretaciones sobre aplicabilidad, adopción y casos de uso combinan resultados reportados por los autores con una lectura editorial orientada a contexto técnico y empresarial. Esa separación es importante: no todo lo que promete un paper se traduce igual de rápido a producto.

Tabla resumen de papers clave

Papers más influyentes que explican la evolución actual de la inteligencia artificial.

| Paper | Área | Por qué importa | Nivel de adopción | Aplicación práctica |

|---|---|---|---|---|

| Attention Is All You Need | Transformers | Arquitectura base de los modelos modernos | Aplicable ya | LLM, multimodal, embeddings |

| Retrieval-Augmented Generation | Search + LLM | Combina generación con recuperación documental | Aplicable ya | Asistentes empresariales y buscadores IA |

| Chain-of-Thought Prompting | Reasoning | Introduce razonamiento paso a paso | Aplicable ya | QA complejo, matemáticas, agentes |

| ReAct | Agentes | Integra razonamiento con acciones | Aplicable ya | Agentes con herramientas |

| Toolformer | Tool use | El modelo aprende cuándo usar APIs | Aplicable ya | Automatización y copilots |

| CLIP | Multimodal | Embeddings compartidos texto-imagen | Aplicable ya | Búsqueda visual |

| Segment Anything | Visión | Segmentación universal promptable | Aplicable ya | Robótica, visión industrial |

| Molmo & PixMo | Vision-language | VLM abierto competitivo | Aplicable / labs | Asistentes multimodales |

| Gated Attention for LLMs | Arquitectura LLM | Mejora estabilidad y contexto largo | Labs avanzados | Diseño de nuevos LLM |

| Data Shapley in One Training Run | Data valuation | Permite medir valor real de los datos | Labs avanzados | Curación de datasets |

| VGGT | Visión 3D | Reconstrucción multivista rápida | Labs avanzados | Robótica y digital twins |

| DDiT | Diffusion | Optimiza inferencia en Diffusion Transformers | Labs avanzados | Generación visual eficiente |

| Artificial Hivemind | Evaluación LLM | Mide homogeneidad entre modelos | Experimental | Benchmark de diversidad |

Tabla completa de 25 papers

Dataset editorial de papers que influyen en el desarrollo actual de la IA.

| Paper | Año | Área | Nivel | Aplicación principal |

|---|---|---|---|---|

| Attention Is All You Need | 2017 | Transformers | Aplicable | Base de LLM |

| BERT | 2018 | NLP | Aplicable | Búsqueda semántica |

| Language Models are Few-Shot Learners | 2020 | LLM | Aplicable | Prompting |

| Retrieval-Augmented Generation | 2020 | Retrieval | Aplicable | Grounded AI |

| Chain-of-Thought Prompting | 2022 | Reasoning | Aplicable | QA complejo |

| Self-Consistency Improves CoT | 2022 | Reasoning | Aplicable | Precisión en reasoning |

| ReAct | 2022 | Agentes | Aplicable | Agentes IA |

| Toolformer | 2023 | Tool use | Aplicable | Integración APIs |

| Switch Transformer | 2021 | Escalado | Aplicable | Mixture-of-experts |

| PaLM | 2022 | LLM | Aplicable | Escalado modelos |

| CLIP | 2021 | Multimodal | Aplicable | Búsqueda visual |

| DALL-E | 2021 | Generative AI | Aplicable | Imagen generativa |

| Diffusion Models Beat GANs | 2021 | Generación | Aplicable | Imagen generativa |

| Flamingo | 2022 | Multimodal | Aplicable | LLM multimodales |

| GPT-4 Technical Report | 2023 | LLM | Aplicable | Frontier models |

| LLaMA | 2023 | Open models | Aplicable | Ecosistema open source |

| Segment Anything | 2023 | Visión | Aplicable | Segmentación universal |

| Reformer | 2020 | Eficiencia | Labs | Transformers largos |

| VGGT | 2025 | 3D Vision | Labs | Reconstrucción 3D |

| MegaSaM | 2025 | SLAM | Labs | Vídeo dinámico |

| Molmo & PixMo | 2025 | Vision-language | Labs | Multimodal open source |

| Gated Attention for LLMs | 2025 | LLM architecture | Labs | Optimización atención |

| Data Shapley in One Run | 2025 | Data valuation | Labs | Curación dataset |

| DDiT | 2025 | Diffusion | Labs | Aceleración generación |

| Artificial Hivemind | 2025 | LLM evaluation | Experimental | Diversidad modelos |